最新发布第19页

排序

n8n 节点详解:触发器、控制流、循环、合并与等待

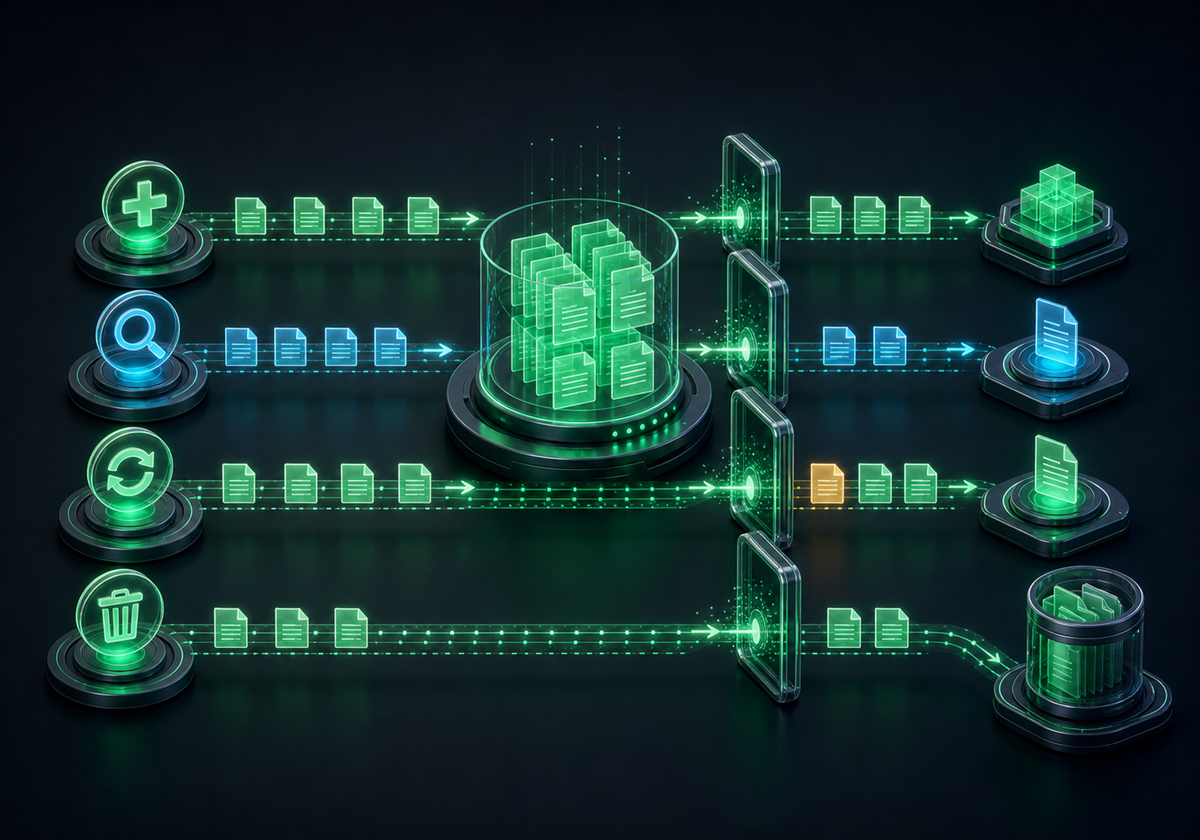

一、触发器节点 1.1 Manual Trigger 最简单的触发器,点击后立即运行,适合调试。 1.2 Schedule Trigger 定时触发,作用类似 Linux 的 Crontab。 1.3 Webhook Webhook 会给你一个 URL,只要访问...

LLaMA-Factory 微调 Qwen3-4B 实战:环境准备与数据配置

一、先明确整体思路 这套流程的目标是:在 AutoDL 云服务器上安装 `LLaMA-Factory`,然后对 `Qwen3-4B` 做微调。 二、环境准备 2.1 购买云主机 笔记里建议使用 AutoDL,选择 3090 显卡即可。如...

LLaMA-Factory 微调 Qwen3-4B 实战:启动训练、测试与导出

一、启动 WebUI 在开始训练前,先把前面的测试命令结束掉,然后启动 WebUI: 浏览器访问: `http://ip:7860` 如果使用的是 AutoDL,仍然需要做自定义服务映射。 需要注意的是:WebUI 版本更适合...

Kubernetes驱动的GPU与大模型管理

一、为什么使用k8s管理GPU与大模型 我们可以从下面六个角度进行分析为什么使用k8s管理GPU与大模型: * 资源调度与优化 * 多租户隔离与资源分配 * 简化部署与管理 * 弹性伸缩和负载均衡 * 高可用...

Kubernetes管理大模型实战

一、K8s使用Model资源部署大模型 1、在 K8s 上部署大模型,可以直接用 Ollama Operator 的 CRD Model 部署,比如部署一个 phi的模型 2、首次部署大模型,会先创建一个 store 服务,用于存储 oll...

Kubernetes管理GPU和大模型技术体系

一、K8s管理GPU资源技术架构 k8s默认不支持管理GPU 安装完英伟达驱动后支持管理GPU 二、K8s管理大模型服务方案 针对vLLM serve、Ollama serve等各类大模型服务,可以使用资源类型为Deployment进...

Kubernetes GPU资源调度落地

一、K8s集群部署 1.1 Runtime安装 1、卸载已经安装的 docker 2、配置源 3、安装 Containerd 4、配置 Containerd 的内核 5、创建 Containerd 的配置文件 6、启动Containerd 1.2 Kubernetes 部署 ...

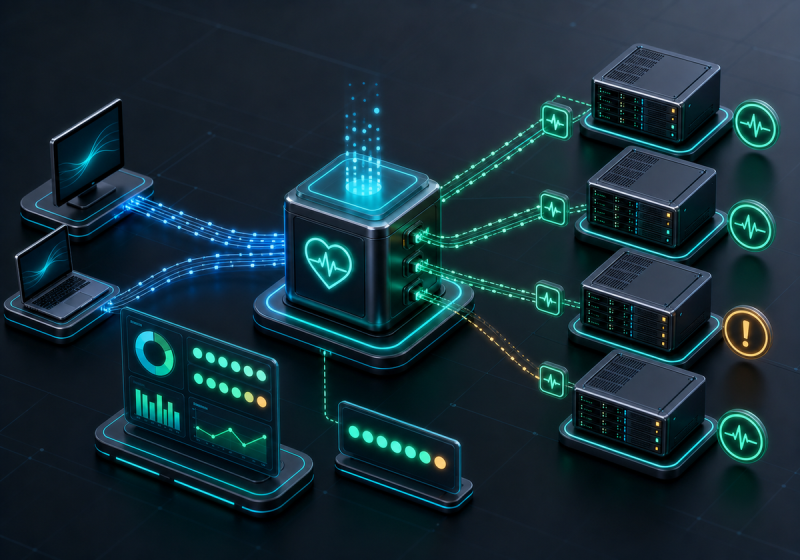

GPU 监控进阶:Prometheus 接入 dcgm-exporter 与显卡大盘

一、为什么还需要 `dcgm-exporter` `node_exporter` 能看到系统级指标,但看不到足够细的 GPU 运行细节。而大模型推理和训练最关心的常常是: * GPU 利用率; * 显存占用; * 温度和功耗; * 显...

智能体入门:什么是 AI Agent,核心要素和主流平台有哪些

一、什么是智能体 AI Agent(智能体)是一种能够感知环境、做出决策并执行行动的软件系统。你可以把它理解成一个“能自己完成任务的 AI 助手”。 和传统聊天机器人相比,智能体不只是回答问题,...

开源版 Coze 私有部署实战:用 Docker 跑起 Coze Studio

一、先准备机器 一个入门级实验环境就够了: * CPU:2C * 内存:4G * 磁盘:40G * 系统:Ubuntu 22.04 如果你只是做实验,使用云上的抢占式实例会更省钱,用完及时销毁即可。 二、安装 Docker ...