一、知识是如何进入参数的

观点:大模型本身没有知识库/数据库,它“大脑”里的知识来源于它的参数。这些知识是通过训练数据学习到的统计规律,编码在神经网络参数中。大模型不像传统数据库通过结构化存储(如表格、关系型数据)和查询接口管理知识,数据可动态增删改查。

问题1:知识如何编码到参数中?

-

参数的作用:模型参数(即神经网络的权重)记录了训练数据中的统计关联性。例如:

-

输入”法国的首都是”,模型参数中可能编码了”巴黎”的高概率输出;

-

输入”量子力学的基础理论是”,参数可能编码了”波函数、不确定性原理”等关联词。

-

知识的动态性:这种编码并非精确的“记忆”,而是对语言模式和事实的概率分布建模。因此,模型可能生成错误

-

答案(尤其是训练数据中低频或矛盾的内容)

问题2:大模型与传统数据库/知识库的核心区别

| 特征 | 大模型 | 传统知识库/数据库 |

|---|---|---|

| 知识存储形式 | 隐式(参数中的权重分布) | 显式(结构化数据条目) |

| 知识更新方式 | 需重新训练或微调 | 动态增删改查 |

| 知识可解释性 | 黑盒,难以追溯来源 | 透明,可查询和验证 |

| 知识推理能力 | 基于统计生成(可能创新或错误) | 基于逻辑规则(严格但缺乏灵活) |

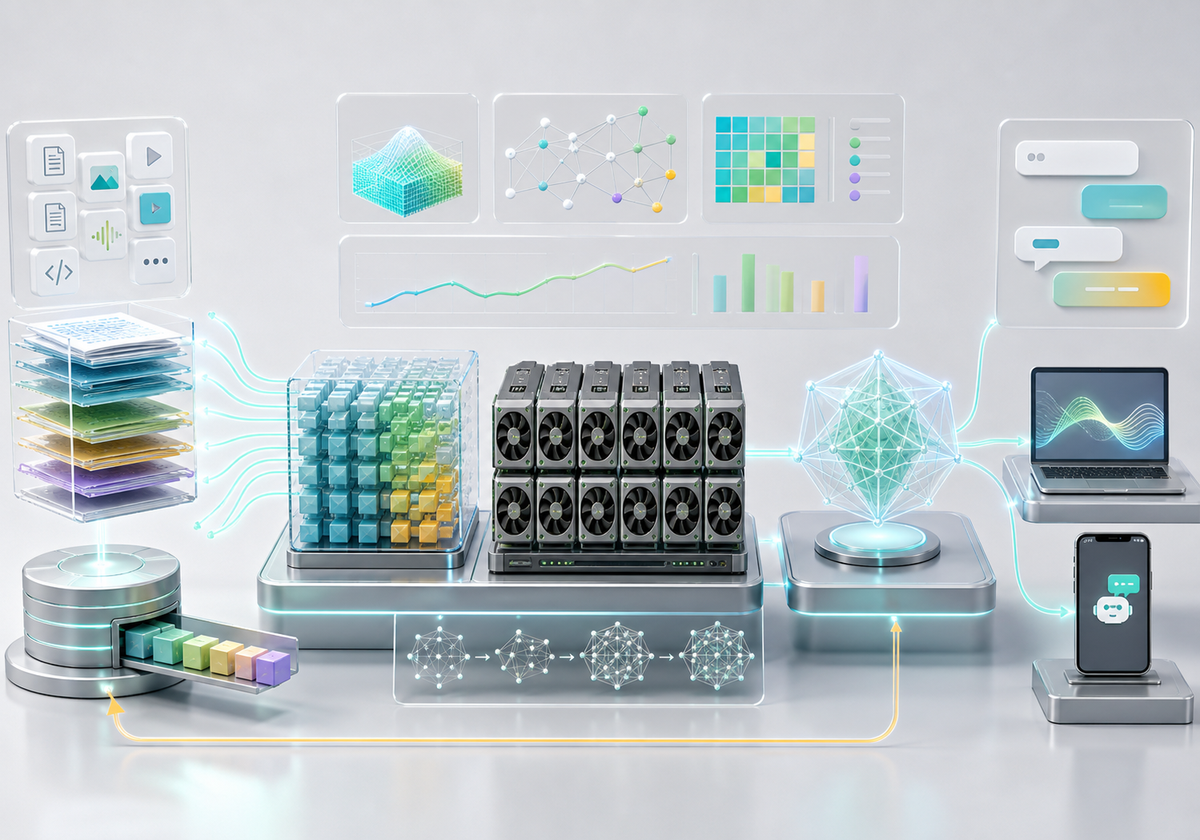

大模型训练

-

会话调教

-

外挂知识库RAG

-

模型微调

大模型数据来源

-

网络公开数据(网络抓取)

-

人工标注(对大模型的输出答案进行排序、评分和编辑)

-

合成数据(规则填充,比如合同、大模型生成)

-

私有领域数据(学术论文、企业日志、私有代码等)

数据处理五大关键步骤

-

数据清洗(去重、去噪、去毒)

-

数据格式化(UTF8编码、JSON格式)

-

数据分词(Tokenization)

-

数据混合(控制来源平衡比例、动态采样,给高质量数据更高权重)

-

数据压缩(最小哈希降低存储空间、布隆过滤器快速查看)

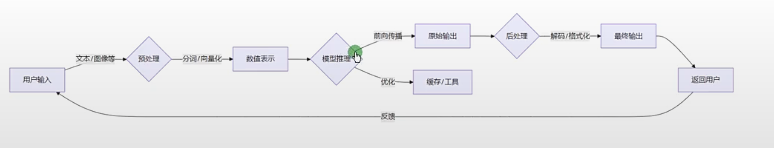

大模型调用数据

-

数据输入

-

来源:用户通过接口(如API、Web界面、命令行)输入数据,可能是文本、图像、语音等。例如,文本输入可以是问题、指令或对话上下文。

-

格式:输入数据通常以结构化格式(如JSON、字符串)或原始格式(如图像文件)传递。

-

上下文管理:对于对话模型,会获取历史对话记录(如上下文窗口)以保持连贯性。

-

数据预处理

-

清洗与标准化:

-

文本:去除无效字符、统一编码(如UTF-8)、分词(tokenization,使用如BPE或WordPiece)。

-

图像:调整尺寸、归一化像素值、转换颜色空间(如 RGB)。

-

语音:转换为频谱图或特征向量(如MFCC)。

-

-

向量化:

- 将输入数据转换为模型可处理的数值表示。例如,文本通过词嵌入(embedding)转为向量,图像通过卷积层提取特征。

-

批处理:

- 为提高效率,多个输入可能被打包成批次(batch)。

-

模型推理

-

数据输入模型:预处理后的数据被送入大模型(如 Transformer 架构的语言模型或扩散模型)。

-

计算过程:

-

参数调用:模型加载预训练权重(可能存储在本地或云端,权重规模可达百亿甚至千亿参数)

-

并行计算:为加速推理,可能使用多 GPU、TPU或分布式计算,数据分片后并行处理。

-

-

上下文处理:对于长序列输入,模型可能使用滑动窗口或稀疏注意力机制以应对内存限制。

-

输出生成:模型生成原始输出(如logits、概率分布、特征图)。

-

数据后处理

-

解码:

-

文本:将模型输出的token 序列解码为人类可读的文本(如通过贪婪搜索、束搜索或采样)。

-

图像:将特征图转换为可视化图像(如去噪后生成高清图片)。

-

语音:将频谱图转为音频波形。

-

-

格式化:根据应用需求调整输出格式,如 JSON、HTML或流式输出。

-

过滤与安全检查:检查输出内容是否符合安全规范(如避免有害信息或偏见)。

-

数据传输与反馈

-

返回结果:处理后的输出通过接口返回给用户(如API响应、界面显示)。

-

日志记录:系统可能记录输入输出数据(匿名化处理)用于优化模型或调试

-

用户交互:如果是大模型对话系统,可能根据用户反馈(如纠错或追问)重新进入数据调用循环。

流程图:

暂无评论内容