排序

LLaMA-Factory 微调 Qwen3-4B 实战:启动训练、测试与导出

一、启动 WebUI 在开始训练前,先把前面的测试命令结束掉,然后启动 WebUI: 浏览器访问: `http://ip:7860` 如果使用的是 AutoDL,仍然需要做自定义服务映射。 需要注意的是:WebUI 版本更适合...

常见开源大模型微调工具盘点:PEFT、LLaMA-Factory、Unsloth、XTuner

一、Hugging Face Transformers 与 PEFT Transformers 是 Hugging Face 的核心开源库,覆盖 NLP、视觉、音频等多种任务,同时把模型加载、Tokenizer、Pipeline 等常见能力做了模块化封装。 PEFT...

大模型为什么离不开 GPU

一、为什么大模型依赖 GPU 大模型(如GPT、DeepSeek等)依赖GPU进行训练和推理 CPU和GPU的区别: | | CPU | GPU | | -------------------------- | --------------------------------------------...

大模型私有化部署前,如何估算硬件配置

- 一、硬件核心配置逻辑 - 1.1 GPU 选型原则 * 显存容量:每 10 亿参数(1B)大约需要 1-2GB 显存,例如 70B 模型通常需要 80GB 级别显存,常见推荐是 A100 或 H100。 * 计算能力:优先选择 FP1...

LLaMA-Factory 微调 Qwen3-4B 实战:环境准备与数据配置

一、先明确整体思路 这套流程的目标是:在 AutoDL 云服务器上安装 `LLaMA-Factory`,然后对 `Qwen3-4B` 做微调。 二、环境准备 2.1 购买云主机 笔记里建议使用 AutoDL,选择 3090 显卡即可。如...

开源大模型私有化部署思路与阿里云 PAI 快速部署

- 一、开源模型一般去哪里找 * Hugging Face:`https://huggingface.co/models` * 魔塔社区:`https://modelscope.cn/models` 一、部署前先把思路定下来 1.1 先确定目标模型 例如以 `QWQ-32B` ...

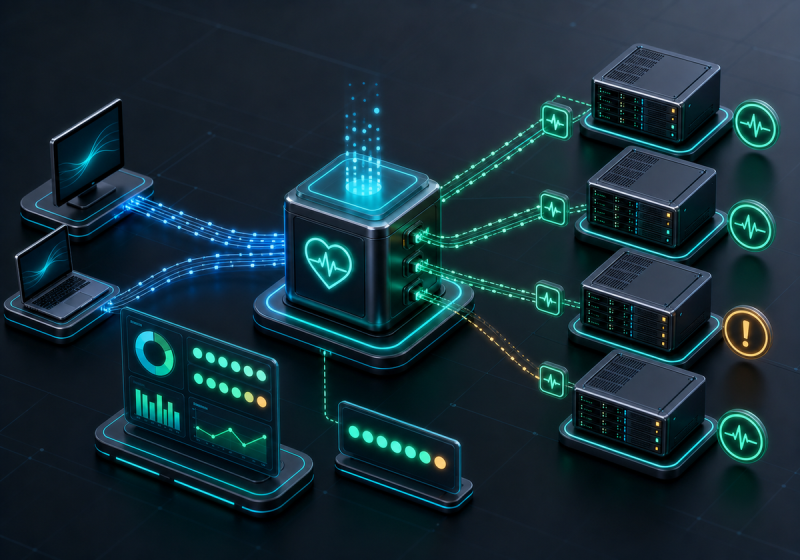

大模型压测入门:核心指标与常见压测工具

一、大模型压测为什么特别重要 相比传统 API,大模型服务的性能不只是“请求快不快”,还涉及: * 首个 Token 出来的速度; * 后续 Token 生成的节奏; * 并发下吞吐是否塌陷; * GPU 利用率是...

大模型私有化部署硬件选型策略与企业案例

- 一、先按需求驱动做决策 - 1.1 数据安全与合规性优先 适用场景 * 金融、医疗、政府等需要遵守数据安全与个人信息保护要求的行业。 * 涉及国家机密,或者跨境数据传输受限的企业。 硬件选型要...

Ollama 私有化部署实战:云主机、模型运行与 OpenWebUI

一、先准备云主机 1.1 AutoDL AutoDL 官网: `https://autodl.com/home` 它的优势通常是便宜、按量付费、适合做实验,但因为是容器化虚拟机,性能体验可能略差一些。 1.2 阿里云 / 腾讯云 GPU ...

用 DistillKit 做大模型蒸馏:Qwen3-8B 到 Qwen3-0.6B

一、DistillKit 是什么 DistillKit 是 Arcee.AI 开源的大模型蒸馏工具包,目标是让研究和工程团队更容易实践多种蒸馏方法。 它支持的主要方向包括: * 基于 logits 的蒸馏; * 基于隐藏状态的蒸...