排序

如何获取并制作大模型微调数据集

一、从 Hugging Face 获取公共数据集 地址: `https://huggingface.co/datasets` 1.1 安装命令行工具 默认前提是机器已经装好 Python 和 pip。 1.2 获取 Token 注册、登录并验证邮箱后,可以在...

LLaMA-Factory 微调 Qwen3-4B 实战:环境准备与数据配置

一、先明确整体思路 这套流程的目标是:在 AutoDL 云服务器上安装 `LLaMA-Factory`,然后对 `Qwen3-4B` 做微调。 二、环境准备 2.1 购买云主机 笔记里建议使用 AutoDL,选择 3090 显卡即可。如...

Go 结构体实战:定义、方法、接收者与嵌套

一、前言 本文主要以下几方面介绍Go语言中的结构体: * 初识结构体 * 结构体初体验 * 结构体操作和比较 * 结构体自定义方法 * 结构体方法接收者类型 * 结构体嵌套 二、初识结构体 2.1 基本含义 G...

Gin 脚手架项目实战:JWT、日志封装与认证中间件

一、什么是脚手架? 脚手架是项目开发的基础框架,脚手架包含了基本了项目结构、依赖管理、构建工具、测试框架等基本功能和配置,脚手架可以使开发者能够非常迅速的展开工作,避免重复造轮了,可以大...

大模型微调怎么选:技术选型与 SFT、DPO、PPO、RLHF

- 一、技术选型时先看什么 - 1.1 按任务复杂度选 * 高复杂度任务: * 例如多轮对话、复杂推理、长文本生成。 * 更适合全参数微调或指令微调。 * 低复杂度任务: * 例如简单分类、关键词提取。 *...

vLLM 私有化部署实战:模型下载、服务启动与接口测试

一、先准备云主机 示例里使用的是 AutoDL。 官网: `https://www.autodl.com/` 二、安装 vLLM 参考文档: `https://docs.vllm.ai/en/latest/getting_started/installation/gpu.html` 如果系统里...

大模型私有化部署硬件选型策略与企业案例

- 一、先按需求驱动做决策 - 1.1 数据安全与合规性优先 适用场景 * 金融、医疗、政府等需要遵守数据安全与个人信息保护要求的行业。 * 涉及国家机密,或者跨境数据传输受限的企业。 硬件选型要...

常见开源大模型微调工具盘点:PEFT、LLaMA-Factory、Unsloth、XTuner

一、Hugging Face Transformers 与 PEFT Transformers 是 Hugging Face 的核心开源库,覆盖 NLP、视觉、音频等多种任务,同时把模型加载、Tokenizer、Pipeline 等常见能力做了模块化封装。 PEFT...

大模型行业选型建议:金融、医疗、制造与教育

一、金融行业 | 细分领域 | 核心要求 | 推荐模型 | 关键能力 | | ---------- | ------------------------ | --------------- | ------------------------------ | | 投研、分析 | 招股书解析、...

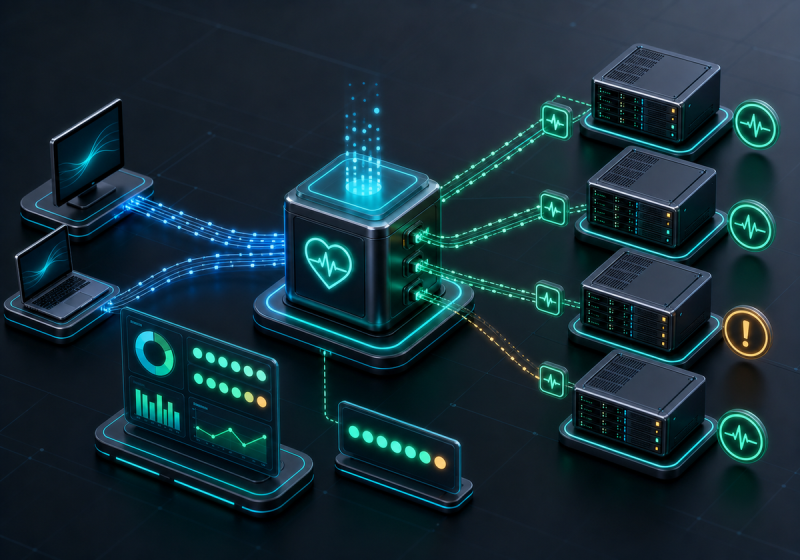

Kubernetes驱动的GPU与大模型管理

一、为什么使用k8s管理GPU与大模型 我们可以从下面六个角度进行分析为什么使用k8s管理GPU与大模型: * 资源调度与优化 * 多租户隔离与资源分配 * 简化部署与管理 * 弹性伸缩和负载均衡 * 高可用...