排序

大模型微调超参数详解:从 Model Size 到 Temperature

一、超参数到底是什么 超参数(Hyperparameters)是在训练开始前就要设定好的参数,用来控制训练过程,而不是训练中自动学到的权重。 一个很直观的比喻是:超参数就像做菜前先决定盐、胡椒、火...

Kubernetes管理GPU和大模型技术体系

一、K8s管理GPU资源技术架构 k8s默认不支持管理GPU 安装完英伟达驱动后支持管理GPU 二、K8s管理大模型服务方案 针对vLLM serve、Ollama serve等各类大模型服务,可以使用资源类型为Deployment进...

如何获取并制作大模型微调数据集

一、从 Hugging Face 获取公共数据集 地址: `https://huggingface.co/datasets` 1.1 安装命令行工具 默认前提是机器已经装好 Python 和 pip。 1.2 获取 Token 注册、登录并验证邮箱后,可以在...

vLLM 集群模式部署:Ray、多机多卡与远程访问

一、先准备机器 示例建议: * 优先使用阿里云。 * GPU 选 A10 或更高等级。 * 不建议选 T4,这类卡在大模型集群场景下通常偏弱。 二、部署前准备 2.1 安装驱动和 CUDA 所有机器都要完成这一步。...

大模型推理优化总览:硬件、系统架构与服务部署

一、大模型优化的核心目标 优化通常围绕四个目标展开: * 降低延迟: * 尤其是首个 Token 时间和生成速度。 * 提高吞吐: * 在固定资源下服务更多请求。 * 降低成本: * 提升资源利用率,降低单...

Kubernetes管理大模型实战

一、K8s使用Model资源部署大模型 1、在 K8s 上部署大模型,可以直接用 Ollama Operator 的 CRD Model 部署,比如部署一个 phi的模型 2、首次部署大模型,会先创建一个 store 服务,用于存储 oll...

常见主流开源大模型盘点

一、先看主流开源大模型全景 | 大模型 | 代表模型 | 公司 | 特点 | | ------------ | ------------- | ---------------- | ------------------------------------------------------------ | | ...

商业大模型微调平台盘点:阿里云 PAI、硅基流动与讯飞星辰

一、阿里云 PAI 地址: `https://pai.console.aliyun.com/` 阿里云 PAI 提供了一站式的大模型训练与部署能力,比较适合已经在云上做 AI 研发,或者希望快速接入微调工作流的团队。 1.1 典型入口...

大模型是什么,它为什么重要

一、先认识什么是大模型 1.1 常见的大模型 常见的大模型: * ChatGPT * DeepSeek * 豆包 * 腾讯元宝 1.2 大模型的定义 大模型定义: * 大语言模型(LLM) * 关键字:大 --> 参数规模比较大、训...

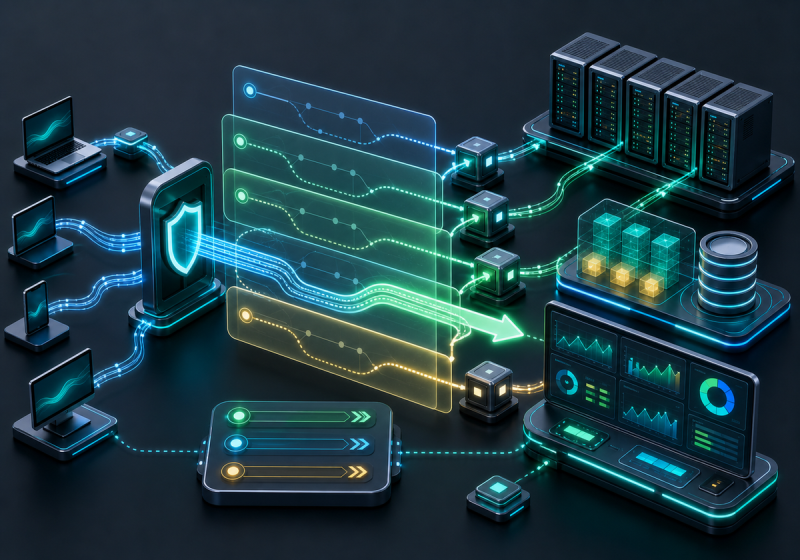

Kubernetes驱动的GPU与大模型管理

一、为什么使用k8s管理GPU与大模型 我们可以从下面六个角度进行分析为什么使用k8s管理GPU与大模型: * 资源调度与优化 * 多租户隔离与资源分配 * 简化部署与管理 * 弹性伸缩和负载均衡 * 高可用...