排序

大模型参数入门:从规模到主流模型量级

一、什么是大模型参数 * 参数单位:B,billion(十亿) * 参数是什么? 大模型参数是通过海量数据训练得到的内部数值,用于存储知识关联并决定模型处理信息的方式。 * 举例1:参数就好比图书馆书架上的...

如何获取并制作大模型微调数据集

一、从 Hugging Face 获取公共数据集 地址: `https://huggingface.co/datasets` 1.1 安装命令行工具 默认前提是机器已经装好 Python 和 pip。 1.2 获取 Token 注册、登录并验证邮箱后,可以在...

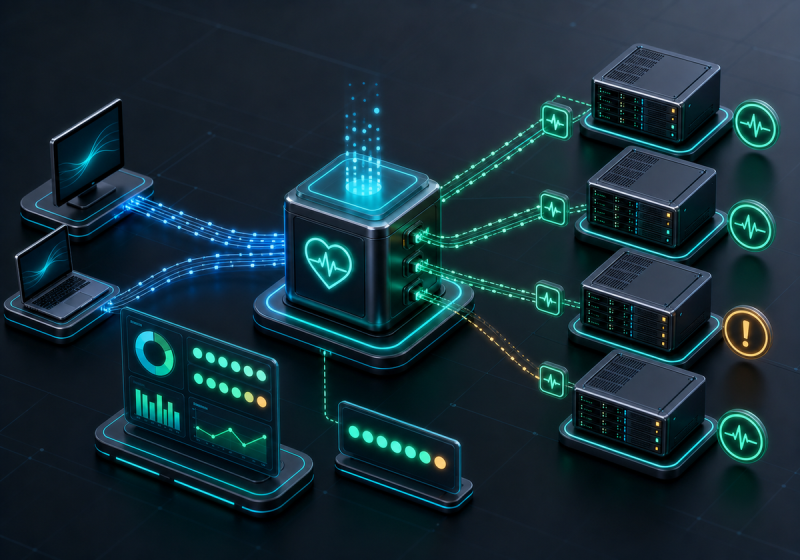

Kubernetes驱动的GPU与大模型管理

一、为什么使用k8s管理GPU与大模型 我们可以从下面六个角度进行分析为什么使用k8s管理GPU与大模型: * 资源调度与优化 * 多租户隔离与资源分配 * 简化部署与管理 * 弹性伸缩和负载均衡 * 高可用...

腾讯云 HAI 体验:从创建实例到 OpenWebUI 测试

一、先创建 HAI 实例 地址: `https://cloud.tencent.com/product/hai` 1.1 进入 HAI 控制台 打开官网后,点击“立即使用”。 1.2 新建算力实例 进入: `算力管理 -> 新建` 1.3 填写实例参数...

大模型量化入门:GPTQ、AWQ 和 Qwen3-1.7B 实操

一、为什么量化很重要 量化的本质是把模型从更高精度的数据格式压缩到更低精度,例如: * FP16 -> INT8 * FP16 -> INT4 这样做带来的主要收益有: * 模型体积更小; * 显存占用更低; * ...

常见主流开源大模型盘点

一、先看主流开源大模型全景 | 大模型 | 代表模型 | 公司 | 特点 | | ------------ | ------------- | ---------------- | ------------------------------------------------------------ | | ...

开源大模型私有化部署思路与阿里云 PAI 快速部署

- 一、开源模型一般去哪里找 * Hugging Face:`https://huggingface.co/models` * 魔塔社区:`https://modelscope.cn/models` 一、部署前先把思路定下来 1.1 先确定目标模型 例如以 `QWQ-32B` ...

大模型私有化部署硬件选型策略与企业案例

- 一、先按需求驱动做决策 - 1.1 数据安全与合规性优先 适用场景 * 金融、医疗、政府等需要遵守数据安全与个人信息保护要求的行业。 * 涉及国家机密,或者跨境数据传输受限的企业。 硬件选型要...

大模型微调怎么选:技术选型与 SFT、DPO、PPO、RLHF

- 一、技术选型时先看什么 - 1.1 按任务复杂度选 * 高复杂度任务: * 例如多轮对话、复杂推理、长文本生成。 * 更适合全参数微调或指令微调。 * 低复杂度任务: * 例如简单分类、关键词提取。 *...

Kubernetes GPU资源调度落地

一、K8s集群部署 1.1 Runtime安装 1、卸载已经安装的 docker 2、配置源 3、安装 Containerd 4、配置 Containerd 的内核 5、创建 Containerd 的配置文件 6、启动Containerd 1.2 Kubernetes 部署 ...