排序

vLLM 集群模式部署:Ray、多机多卡与远程访问

一、先准备机器 示例建议: * 优先使用阿里云。 * GPU 选 A10 或更高等级。 * 不建议选 T4,这类卡在大模型集群场景下通常偏弱。 二、部署前准备 2.1 安装驱动和 CUDA 所有机器都要完成这一步。...

腾讯云 HAI 体验:从创建实例到 OpenWebUI 测试

一、先创建 HAI 实例 地址: `https://cloud.tencent.com/product/hai` 1.1 进入 HAI 控制台 打开官网后,点击“立即使用”。 1.2 新建算力实例 进入: `算力管理 -> 新建` 1.3 填写实例参数...

vLLM 私有化部署实战:模型下载、服务启动与接口测试

一、先准备云主机 示例里使用的是 AutoDL。 官网: `https://www.autodl.com/` 二、安装 vLLM 参考文档: `https://docs.vllm.ai/en/latest/getting_started/installation/gpu.html` 如果系统里...

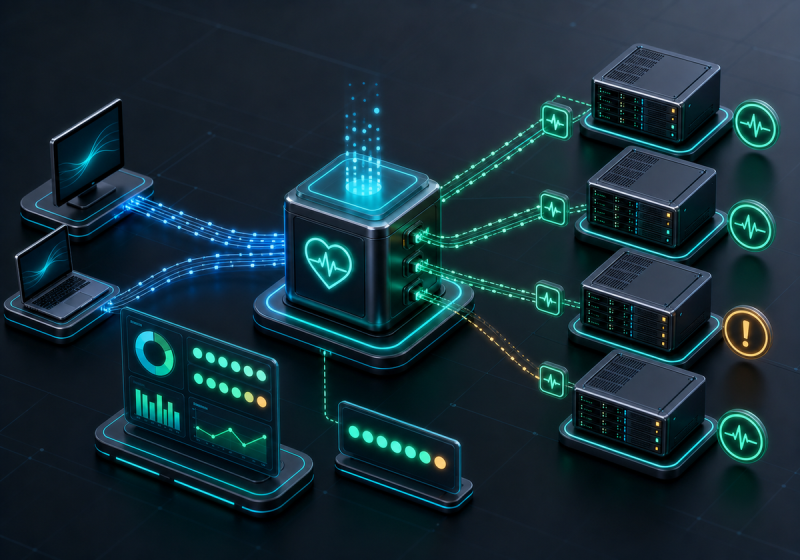

大模型私有化部署硬件选型策略与企业案例

- 一、先按需求驱动做决策 - 1.1 数据安全与合规性优先 适用场景 * 金融、医疗、政府等需要遵守数据安全与个人信息保护要求的行业。 * 涉及国家机密,或者跨境数据传输受限的企业。 硬件选型要...

大模型与Ollama初体验

一、Ollama介绍与特性 1.1 什么是Ollama Ollama是一个轻量级、易于使用的大模型管理和部署工具,主要用于简化大模型的运行和交互。并且为开发者和用户提供了快速加载、管理和调用多种主流大模型...

开源大模型私有化部署思路与阿里云 PAI 快速部署

- 一、开源模型一般去哪里找 * Hugging Face:`https://huggingface.co/models` * 魔塔社区:`https://modelscope.cn/models` 一、部署前先把思路定下来 1.1 先确定目标模型 例如以 `QWQ-32B` ...

大模型私有化部署前,如何估算硬件配置

- 一、硬件核心配置逻辑 - 1.1 GPU 选型原则 * 显存容量:每 10 亿参数(1B)大约需要 1-2GB 显存,例如 70B 模型通常需要 80GB 级别显存,常见推荐是 A100 或 H100。 * 计算能力:优先选择 FP1...

Ollama 私有化部署实战:云主机、模型运行与 OpenWebUI

一、先准备云主机 1.1 AutoDL AutoDL 官网: `https://autodl.com/home` 它的优势通常是便宜、按量付费、适合做实验,但因为是容器化虚拟机,性能体验可能略差一些。 1.2 阿里云 / 腾讯云 GPU ...