排序

开源大模型私有化部署思路与阿里云 PAI 快速部署

- 一、开源模型一般去哪里找 * Hugging Face:`https://huggingface.co/models` * 魔塔社区:`https://modelscope.cn/models` 一、部署前先把思路定下来 1.1 先确定目标模型 例如以 `QWQ-32B` ...

大模型如何训练:参数、数据与调用流程

一、知识是如何进入参数的 观点:大模型本身没有知识库/数据库,它“大脑”里的知识来源于它的参数。这些知识是通过训练数据学习到的统计规律,编码在神经网络参数中。大模型不像传统数据库通过结...

大模型量化入门:GPTQ、AWQ 和 Qwen3-1.7B 实操

一、为什么量化很重要 量化的本质是把模型从更高精度的数据格式压缩到更低精度,例如: * FP16 -> INT8 * FP16 -> INT4 这样做带来的主要收益有: * 模型体积更小; * 显存占用更低; * ...

大模型私有化部署前,如何估算硬件配置

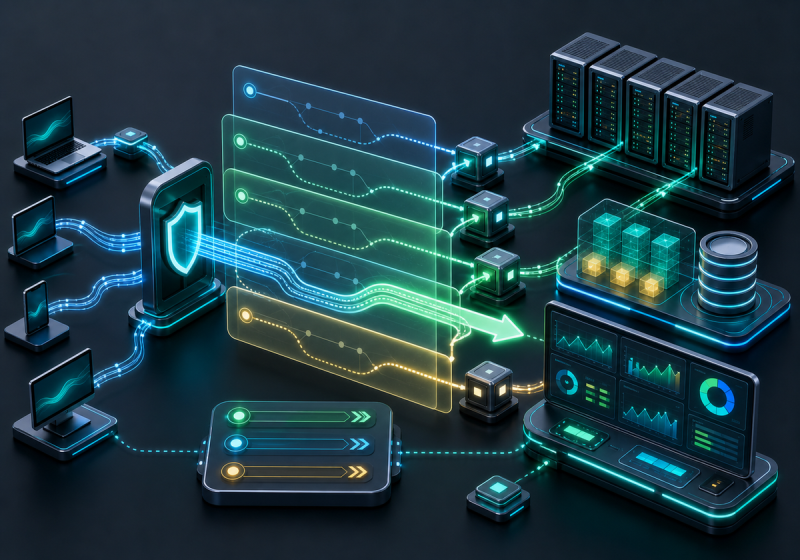

- 一、硬件核心配置逻辑 - 1.1 GPU 选型原则 * 显存容量:每 10 亿参数(1B)大约需要 1-2GB 显存,例如 70B 模型通常需要 80GB 级别显存,常见推荐是 A100 或 H100。 * 计算能力:优先选择 FP1...

Ollama 私有化部署实战:云主机、模型运行与 OpenWebUI

一、先准备云主机 1.1 AutoDL AutoDL 官网: `https://autodl.com/home` 它的优势通常是便宜、按量付费、适合做实验,但因为是容器化虚拟机,性能体验可能略差一些。 1.2 阿里云 / 腾讯云 GPU ...

大模型运维监控入门:命令行工具、Prometheus 与 Grafana

一、先用命令行工具做最小监控 1.1 NVIDIA GPU:`nvidia-smi` 这是最基础也最常用的 NVIDIA GPU 监控工具,前提是已经安装好显卡驱动。 常见用法: 它最适合做: * 快速排查显存占用; * 看当前...

GPU 监控进阶:Prometheus 接入 dcgm-exporter 与显卡大盘

一、为什么还需要 `dcgm-exporter` `node_exporter` 能看到系统级指标,但看不到足够细的 GPU 运行细节。而大模型推理和训练最关心的常常是: * GPU 利用率; * 显存占用; * 温度和功耗; * 显...

大模型是什么,它为什么重要

一、先认识什么是大模型 1.1 常见的大模型 常见的大模型: * ChatGPT * DeepSeek * 豆包 * 腾讯元宝 1.2 大模型的定义 大模型定义: * 大语言模型(LLM) * 关键字:大 --> 参数规模比较大、训...

常见主流闭源大模型盘点

一、主流闭源大模型概览 | 模型 | 代表模型 | 公司 | 特点 | | -------- | ---------------------- | ------------ | ------------------------------------------------------------ | | GPT ...

用 EvalScope 压测 Qwen3-8B:从环境准备到指标解读

一、压测对象 这份实战使用的是硅基流动提供的免费 `Qwen3-8B` 服务。 模型入口示意: 获取 API Key 的流程同样在平台控制台中完成。 公开文档里只建议写成: * `SILICONFLOW_API_KEY=` 二、准...