排序

RAGFlow 部署与快速体验:Linux 安装、模型配置、知识库和聊天

一、部署前的机器要求 生产环境通常建议: * CPU >= 4 cores * RAM >= 16 GB * Disk >= 50 GB * Docker >= 24 * Docker Compose >= 2.26 演示环境里使用的是: * Ubuntu 22.04 *...

Coze 进阶实战:对话流、知识库与数据库怎么用

一、什么是对话流 对话流本质上是一种专门面向对话场景的工作流,更适合: * 智能客服; * 个人助手; * 虚拟角色; * 需要多轮上下文的对话应用。 1.1 对话流和工作流的区别 最关键的差异在于...

RAGFlow 项目实战:做一个公司内部员工智能问答助手

一、项目目标 这个项目的目标是: * 把员工手册和培训手册导入 RAGFlow; * 做一个公司内部知识问答助手; * 再把它嵌入 OA 或企业内部页面。 二、准备知识文档 如果你没有现成资料,可以先用生...

Dify RAG 实战:知识库应用与智能客服落地

一、在 Dify 中创建知识库 入口: `知识库 -> 创建知识库` 上传文件后,一般可以先保持默认分段配置,然后点击保存并处理。 二、把知识库绑定到应用 创建一个新应用时,可以直接把知识库挂进...

向量数据库入门:向量是什么,为什么 RAG 离不开它

一、向量是什么 在 AI 场景里,向量可以理解成一个“很长的数字列表”,例如: 这个数字列表不是随便生成的,它通常承载了原始数据的语义或特征。 例如: * 一张图片会被编码成代表颜色、形状、...

FastGPT 入门与安装:功能定位、应用场景和 Docker 部署

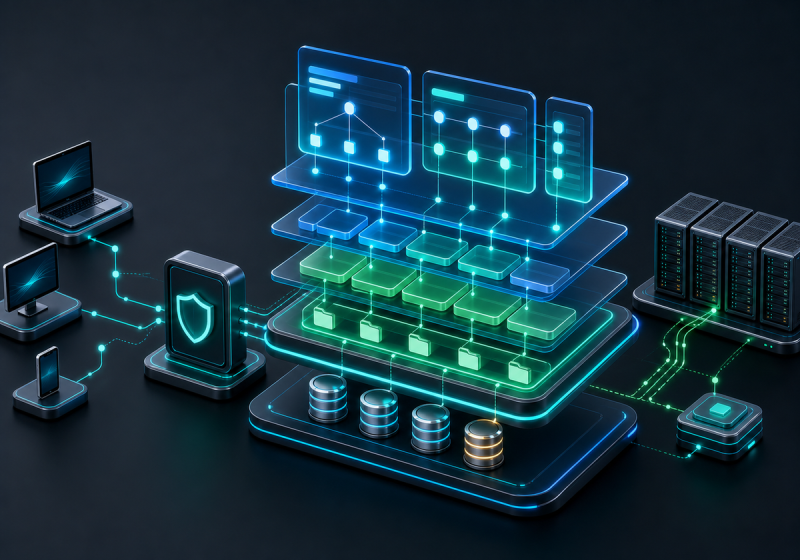

一、FastGPT 是什么 FastGPT 是一个基于大语言模型的开源知识库问答系统,目标是帮助用户快速构建专属 AI 助手,尤其适合企业内部文档问答和复杂知识检索场景。 二、FastGPT 的核心能力 2.1 知...

FastGPT 快速上手:配置模型、创建应用、工作流与知识库

一、先配置大模型 1.1 配置 DeepSeek 进入: `模型提供商 -> 模型配置` 搜索 `deepseek`,启用 `deepseek-chat`。 模型参数一般先保持默认即可: 然后到: `模型提供商 -> 模型渠道 ->...

FastGPT 项目实战:做一个公司内部员工智能问答助手

一、项目目标 目标是做一个公司内部员工智能问答助手,能够基于以下资料回答问题: * 员工手册; * 各部门培训手册; * 技术部内部资源使用说明。 最终可以把这个助手发布到公司内部 OA 或门户...

Milvus Python 实战:创建集合、插入数据、搜索与更新

一、先安装 Python 客户端 这里最好让 `pymilvus` 版本和 Milvus 服务版本尽量对应。 二、连接到 Milvus 最基础的连接方式如下: 三、创建集合 示例里使用的是 8 维向量,便于演示。 核心步骤包...

Milvus 快速入门:Linux 单机部署、Docker 安装与 WebUI

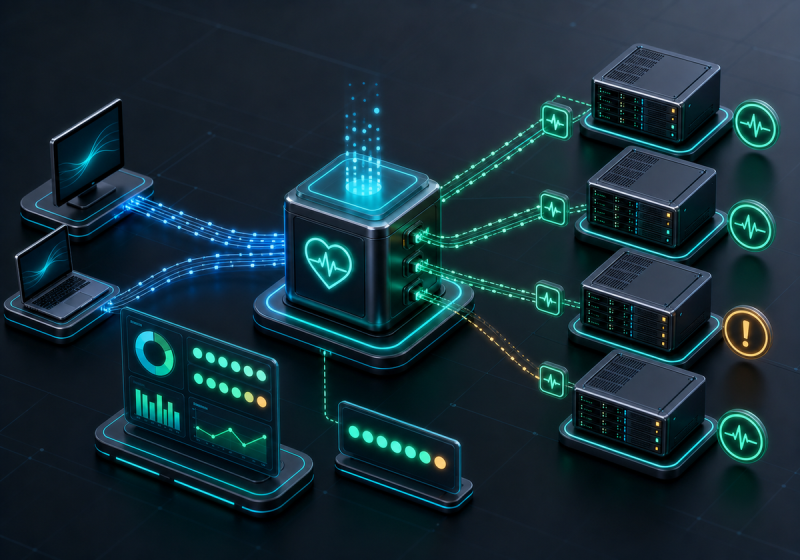

一、Milvus 是什么 Milvus 是一个面向 AI 时代海量向量数据的高性能、可扩展、云原生开源向量数据库。 它的核心价值是: * 专为向量检索设计; * 支持大规模向量存储和相似搜索; * 适合推荐系...