一、启动 WebUI¶

在开始训练前,先把前面的测试命令结束掉,然后启动 WebUI:

llamafactory-cli webui

浏览器访问:

http://ip:7860

如果使用的是 AutoDL,仍然需要做自定义服务映射。

需要注意的是:WebUI 版本更适合单机单卡,如果是多卡环境,优先考虑命令行方式。

二、预览训练命令¶

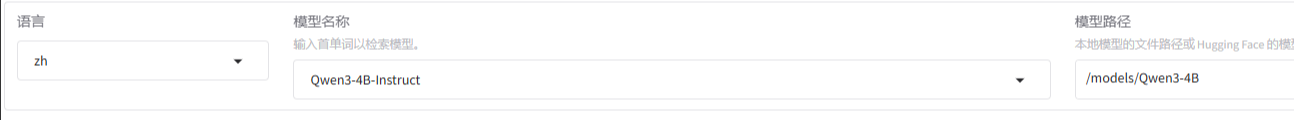

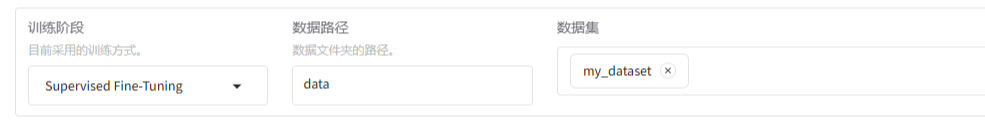

在 WebUI 中点击“预览命令”,可以直接看到等价的训练命令。示例如下:

CUDA_VISIBLE_DEVICES=0 llamafactory-cli train \

--stage sft \

--do_train True \

--model_name_or_path /models/Qwen3-4B \

--preprocessing_num_workers 16 \

--finetuning_type lora \

--template qwen3 \

--flash_attn auto \

--dataset_dir data \

--dataset my_dataset \

--cutoff_len 2048 \

--learning_rate 5e-05 \

--num_train_epochs 5.0 \

--max_samples 100000 \

--per_device_train_batch_size 2 \

--gradient_accumulation_steps 8 \

--lr_scheduler_type cosine \

--max_grad_norm 1.0 \

--logging_steps 5 \

--save_steps 100 \

--warmup_steps 0 \

--packing False \

--report_to none \

--output_dir saves/Qwen3-4B-Instruct/lora/my_finetune \

--bf16 True \

--plot_loss True \

--trust_remote_code True \

--ddp_timeout 180000000 \

--include_num_input_tokens_seen True \

--optim adamw_torch \

--lora_rank 8 \

--lora_alpha 16 \

--lora_dropout 0 \

--val_size 0.1 \

--lora_target all

三、几个关键参数怎么理解¶

--stage sft:- 表示当前做的是监督微调。

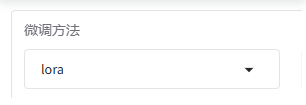

--finetuning_type lora:- 使用 LoRA 节省显存。

--dataset:- 指定你前面在

dataset_info.json中定义的数据集名称。 --output_dir:- 模型输出目录。

--bf16:- 使用半精度,适合支持 BF16 的显卡。

--per_device_train_batch_size:- 每个设备一次处理的样本数,直接影响显存。

--gradient_accumulation_steps:- 通过梯度累积模拟更大的 batch。

--num_train_epochs:- 训练轮次。

--learning_rate:- 学习率,LoRA 场景下常从

5e-05起步。 --val_size 0.1:- 从训练集里抽 10% 做验证集。

如果显存不足,最常见的做法是:

- 把

per_device_train_batch_size调小; - 把

gradient_accumulation_steps调大。

四、微调后的推理测试¶

训练完成后,可以继续用 WebUI 做测试:

CUDA_VISIBLE_DEVICES=0 llamafactory-cli webchat \

--model_name_or_path /models/Qwen3-4B \

--adapter_name_or_path saves/Qwen3-4B-Instruct/lora/my_finetune \

--template qwen

如果更喜欢命令行对话,也可以使用:

CUDA_VISIBLE_DEVICES=0 llamafactory-cli chat \

--model_name_or_path /models/Qwen3-4B \

--adapter_name_or_path saves/Qwen3-4B-Instruct/lora/my_finetune \

--template qwen

五、导出模型¶

如果要分享或部署完整模型,可以把 LoRA 适配器导出并合并:

llamafactory-cli export \

--model_name_or_path /models/Qwen3-4B \

--adapter_name_or_path saves/Qwen3-4B-Instruct/lora/my_finetune \

--template qwen \

--finetuning_type lora \

--export_dir /models/Qwen3-4B-Aminglinux

六、LLaMA-Factory 这条路线最适合什么人¶

如果你希望在一个相对统一的框架里完成训练、测试、对话、导出和后续部署衔接,LLaMA-Factory 会比只用底层脚本更省心,尤其适合第一次系统化做开源大模型微调的人。