排序

Vercel部署实战:从导入GitHub到绑定域名

一、先准备 Vercel 账号 访问:https://vercel.com/ 通常可以直接使用 GitHub 账号登录。 二、导入 GitHub 项目 进入 Vercel 后,新建项目,然后选择导入 GitHub 仓库。 三、配置环境变量 如果...

OpenClaw多Agent进阶:SOUL.md、USER.md 与 AGENTS.md 协作机制

一、给不同 Agent 设置角色人设 1.1 技术 Agent 的 SOUL.md 定义SOUL.md 定义USER.md 1.2 内容 Agent 的 SOUL.md 定义SOUL.md 定义USER.md 1.3 运营 Agent 的 SOUL.md USER.md 1.4 财务 Agent ...

RAG 进阶:典型架构、Rerank 和重排序模型怎么选

一、RAG 的典型架构 一个比较完整的 RAG 架构,通常包含三块能力: 1.1 知识库内容整理 文档不会直接原样扔进系统,而是要先切分成适合检索的片段。 常见切分方式包括: * 固定字数切分; * 按...

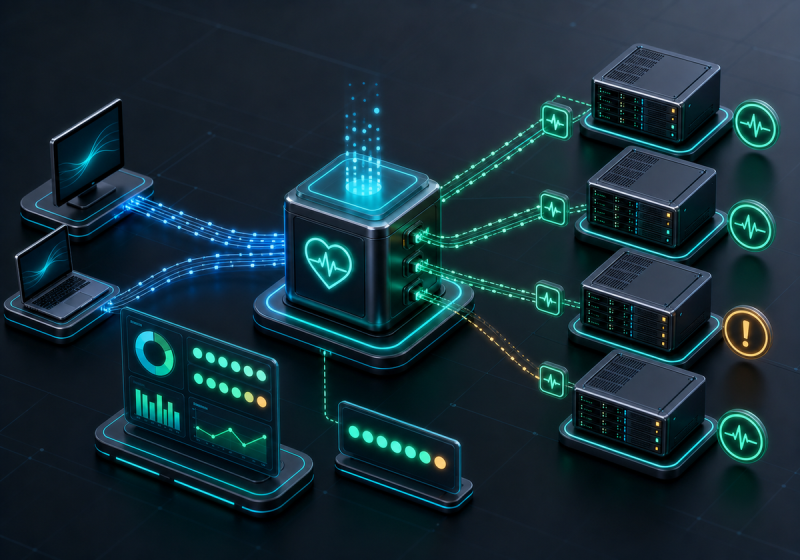

大模型私有化部署前,如何估算硬件配置

- 一、硬件核心配置逻辑 - 1.1 GPU 选型原则 * 显存容量:每 10 亿参数(1B)大约需要 1-2GB 显存,例如 70B 模型通常需要 80GB 级别显存,常见推荐是 A100 或 H100。 * 计算能力:优先选择 FP1...

Dify 入门与本地部署:认识平台并在 Linux 上跑起来

一、Dify 到底是什么 Dify 是一个面向大语言模型应用的开源开发平台,它的目标是让开发者、产品经理甚至业务同学,都能通过可视化方式快速搭建 AI 应用、智能体和 API。 它的几个核心价值可以概...

LLaMA-Factory 微调 Qwen3-4B 实战:环境准备与数据配置

一、先明确整体思路 这套流程的目标是:在 AutoDL 云服务器上安装 `LLaMA-Factory`,然后对 `Qwen3-4B` 做微调。 二、环境准备 2.1 购买云主机 笔记里建议使用 AutoDL,选择 3090 显卡即可。如...

开源大模型私有化部署思路与阿里云 PAI 快速部署

- 一、开源模型一般去哪里找 * Hugging Face:`https://huggingface.co/models` * 魔塔社区:`https://modelscope.cn/models` 一、部署前先把思路定下来 1.1 先确定目标模型 例如以 `QWQ-32B` ...