排序

OpenClaw配置大模型与Gateway:接入模型、理解控制中枢

一、配置 OpenClaw 大模型 本教程基于(codex)gpt大模型中转站 1、注册 注册地址:https://codexzh.com/ 2、购买套餐 如果是试用,可以购买日卡套餐,这里建议购买月卡(标准)套餐 大家不仅可...

FastGPT 项目实战:做一个公司内部员工智能问答助手

一、项目目标 目标是做一个公司内部员工智能问答助手,能够基于以下资料回答问题: * 员工手册; * 各部门培训手册; * 技术部内部资源使用说明。 最终可以把这个助手发布到公司内部 OA 或门户...

大模型微调超参数详解:从 Model Size 到 Temperature

一、超参数到底是什么 超参数(Hyperparameters)是在训练开始前就要设定好的参数,用来控制训练过程,而不是训练中自动学到的权重。 一个很直观的比喻是:超参数就像做菜前先决定盐、胡椒、火...

Coze+Ansible实战:插件、工作流与自动化运维智能体

一、创建coze插件 工具: exec_playbook 代码 依赖包 元数据: 测试: 1.1 创建coze工作流 需要提前创建一个智能体,并定义用户变量ANSIBLE_API_TOKEN 试运行 发布 1.2 配置coze智能体 前面已经...

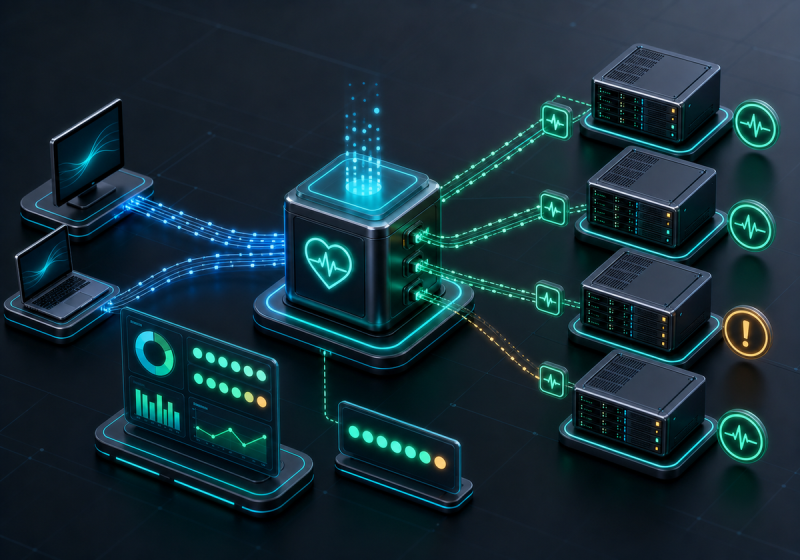

Kubernetes管理GPU和大模型技术体系

一、K8s管理GPU资源技术架构 k8s默认不支持管理GPU 安装完英伟达驱动后支持管理GPU 二、K8s管理大模型服务方案 针对vLLM serve、Ollama serve等各类大模型服务,可以使用资源类型为Deployment进...

如何获取并制作大模型微调数据集

一、从 Hugging Face 获取公共数据集 地址: `https://huggingface.co/datasets` 1.1 安装命令行工具 默认前提是机器已经装好 Python 和 pip。 1.2 获取 Token 注册、登录并验证邮箱后,可以在...

Dify+Elasticsearch MCP:搜索与日志运维智能体

一、准备ElasticSearch环境 服务器:Rocky9 2C4G 1.1 配置yum仓库 1.2 dnf安装es 1.3 修改配置 1.4 设置主机名 1.5 启动服务 1.6 设置elastic用户密码 访问 1.7 基础操作 创建索引 假设我们要创...

n8n 入门与部署:什么是 n8n,如何用 Docker 跑起来

一、什么是 n8n n8n 是一款开源、可自托管、可视化的工作流自动化平台。你可以把它理解成一个“节点式自动化引擎”,通过拖拽节点把不同服务串起来,完成定时任务、数据同步、消息通知和 AI 自...

vLLM 集群模式部署:Ray、多机多卡与远程访问

一、先准备机器 示例建议: * 优先使用阿里云。 * GPU 选 A10 或更高等级。 * 不建议选 T4,这类卡在大模型集群场景下通常偏弱。 二、部署前准备 2.1 安装驱动和 CUDA 所有机器都要完成这一步。...

Claude Code 与 Codex:命令行 AI 编程助手实战

一、Claude Code 是什么 Claude Code 是 Anthropic 推出的终端原生 AI 编程助手,核心特点是: 直接运行在命令行里; 更适合复杂任务、多步骤修改和大型代码库理解; 能把自然语言指令转成实际...